Et même plus grâce à deux nouvelles IA tout juste sorties. Il s’agit de Cicero, conçue par Meta, et de DeepNash, créée par DeepMind. Elles ont toutes les deux développé des qualités de négociation et de persuasion hors pair en s’aidant aussi de la ruse et de la stratégie pour arriver à leurs fins.

Cicero, le grand stratège

Mais comment apprendre à argumenter et convaincre ? Pour entraîner Cicero, les chercheurs ont eu recours à un jeu de stratégie particulièrement complexe, Diplomacy. Les participants doivent s’y montrer sans pitié, forger des alliances, élaborer des plans de bataille, mais aussi négocier pour espérer conquérir une version stylisée de l’Europe. Résultat : après quelques mois d’apprentissage, Cicero a affronté des êtres humains dans la version en ligne du jeu, webDiplomacy.net. Et il est parvenu à se classer dans le top 10 des meilleurs joueurs. Une performance qui a même surpris ses créateurs, qui pensaient qu’il faudrait des années pour atteindre ce niveau.

« Ce succès repose sur la combinaison réussie de deux domaines différents de l’IA : le raisonnement stratégique et le traitement du langage naturel », explique Yann LeCun.

DeepNash, le roi du bluff

Là où l’IA est devenue particulièrement performante, c’est dans ce qu’on appelle « l’équilibre de Nash » (d’où son nom). Il parvient le plus souvent à prévoir correctement le choix de l’adversaire et peut donc maximiser ses gains. Une maîtrise telle du jeu Stratego que DeepNash a atteint le Top 3 des meilleurs joueurs sur Gravon, la plus grande plateforme en ligne de ce jeu. Un tour de force qui a fait l’objet d’une publication dans le magazine Science.

De la stratégie au machiavélisme

« C’est un excellent exemple de combien il est possible de tromper d’autres êtres humains. Ces outils sont super effrayants » et « pourraient être utilisés pour le mal », a-t-il déclaré au Washington Post.

Leur capacité à garder secrètes des informations, à avoir plusieurs coups d’avance sur leurs adversaires et à dominer les êtres humains dans le cadre de jeux de stratégie complexes sont sources de préoccupations bien légitimes. On peut en effet craindre que ces outils ne soient détournés pour mettre en place des arnaques encore plus poussées que celles que nous connaissons déjà aujourd’hui. Entre de mauvaises mains et combinées aux deepfakes, ces intelligences artificielles pourraient avoir des effets dévastateurs pour détourner de l’argent, pénétrer des systèmes informatiques ou rançonner des entreprises.

La cybersécurité ne sera plus tant une problématique si on s’aperçoit que des IA peuvent, avec une grande facilité, flouer les êtres humains et les berner pour les amener à donner des informations stratégiques sans qu’ils en aient conscience. Certains individus sont déjà capables d’envoyer de l’argent à une « riche héritière » qui ne peut débloquer les millions de son héritage (mais qui a le vilain défaut de multiplier les fautes de grammaire).

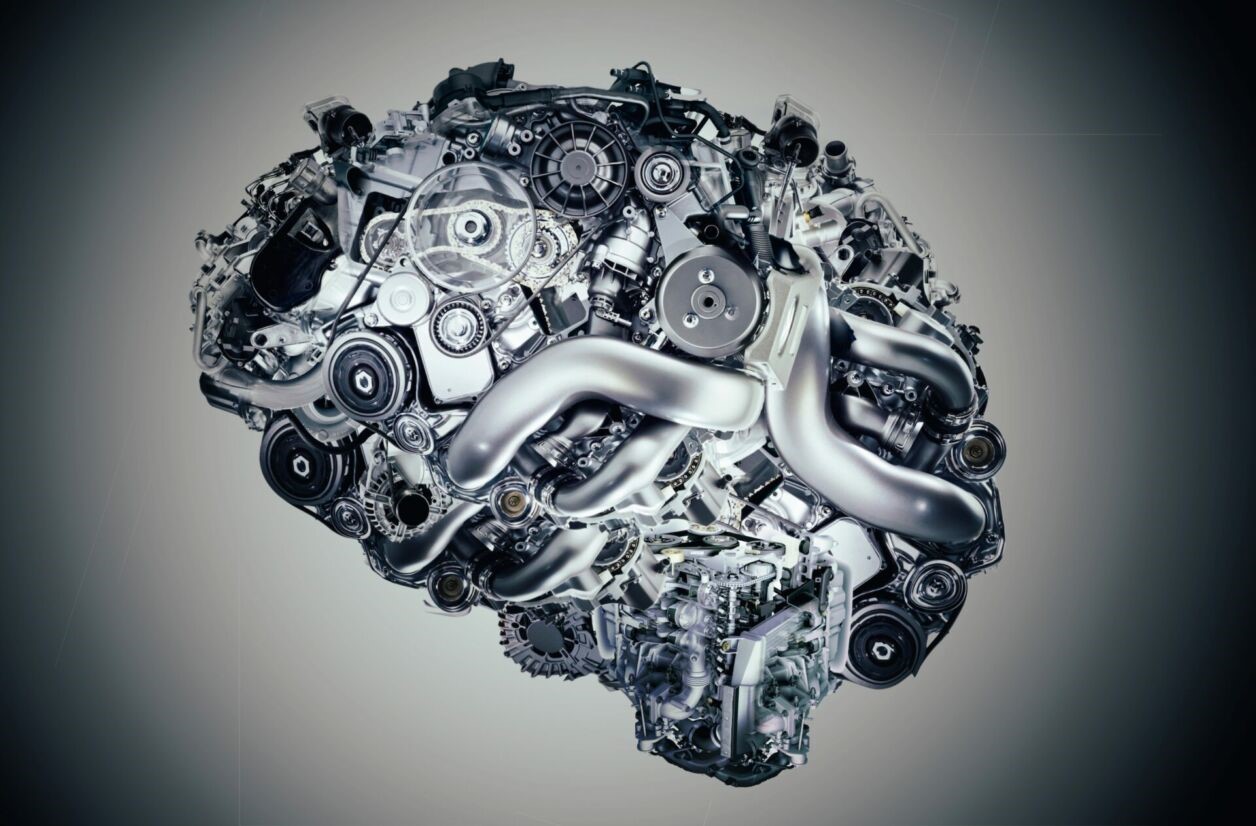

Que se passera-t-il quand une « personne », avec une histoire bien plus étoffée, amenée par étapes, dans un français parfait et avec l’aide de nombreuses photos crédibles pour prouver la véracité du propos, prendra contact et vous demandera un service ? Pire, si cette personne se fait passer pour un proche après avoir appris tous les détails de sa vie sur le Net, adopté ses tics de langage et son apparence ? Voilà un nouveau défi de taille pour le cerveau humain…

Rédigé par Florence Santrot, Repris et adapté par la Fondation Tamkine

#Tamkine_ensemble_nous_reussirons

L'accueil

L'accueil